论文阅读_ECMVSNet

基本信息

| 项目 | 内容 |

|---|---|

| 论文标题 | EC-MVSNet: Enhanced Cascaded Multi-View Stereo with Cross-Scale Relevance Integration |

| 作者 | wangshaoqian |

| 作者单位 | |

| 时间 | 2025 |

| 发表会议/期刊 | AAAI |

方法概览

| 特点 | 文章性质 |

|---|---|

| 输入 | 标定之后的多视角图像 |

| 输出 | 场景的点云图 |

| 所属领域 | MVS |

背景

创新点

- 利用小尺度信息在构建代价体的时候构造一个patch一样

网络架构

摘要

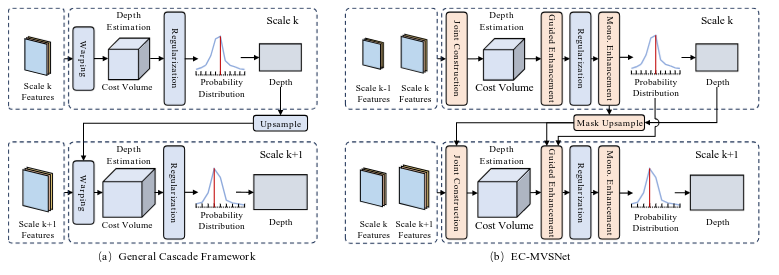

基于级联的多尺度多视图立体(MVS)架构是目前多视图立体重建的主流,实现了计算效率和重建精度之间的平衡。然而,现有的级联 MVS 方法在跨尺度信息利用方面存在重大局限性,其中深度估计过程跨尺度独立运行,而没有充分利用相邻尺度之间的丰富相关性。为了解决这一基本限制,我们提出了增强级联多视图立体框架(ECMVSNet),该框架引入了一种新颖的跨尺度相关性集成策略。

我们的框架包含三个关键组件:

- 一个跨尺度基于特征的联合构建 (CFC,Cross-Scale Feature-based Joint Con-struction) 模块,该模块协同组合相邻尺度的特征以构建更可靠的成本量。利用跨尺度特征来构建成本体积

- 一个跨尺度概率引导增强 (CPE,Cross-Scale Probability-guided Enhancement) 模块,该模块跨尺度传播深度概率分布以指导成本量增强。利用前一个尺度的深度概率分布作为指导,增强当前尺度下的成本体积。

- 以及一个单目基于特征的细化 (MFR,Monocular Feature-based Refinement) 模块,它利用单眼先验进一步提高深度预测精度。利用单眼先验,通过概率分布优化和掩码引导的上采样来完善深度估计,将高质量的估计传播到后续尺度。

大量实验表明,EC-MVSNet 在多个基准测试中取得了最先进的性能,验证了跨尺度集成在提高 MVS 重建质量方面的有效性。

引言

相关工作

- 基于学习的 MVS不看了

- Cross-Scale Relevance Integration in MVS

- 扩散模型随机噪声开始,通过迭代去噪过程恢复数据样本。他们在图像和视频[生成任务中取得了令人瞩目的成果。近年来,许多研究人员表明,扩散模型可用于许多几何估计任务,例如单眼深度估计、单眼法向估计、深度完成、特征匹配、位姿估计和光流估计。随着条件扩散模型的引入,这些方法的性能优于以前最先进的方法。

- Confidence estimation in stereo/MVS.

- UCS-Net(Cheng 等人,2020 年)通过计算深度概率分布与前一个尺度的像素方差,自适应地确定当前尺度的深度搜索范围。

- EPP-MVSNet(马等人,2021)提出了一种熵细化策略,通过对先前尺度的深度概率分布进行熵计算来建立深度搜索范围。

方法

损失函数

损失函数 L 包括所有深度图的损失,即初始深度 D、基于扩散的细化 {D} 内的中间深度在时间步长 t 以及所有上采样的深度图。

对于深度图:按照 IterMVS [28],我们将深度图 D 转换为公式 9 的归一化逆空间,并计算 Lloss 与地面实况深度图 D的归一化逆深度差值:

对于基于扩散的细化中的深度图 D:我们估计相应的置信度 C,我们将 C 包含在损失函数中,如下所示:

继[27]、[28]、[54]之后,我们对深度图使用指数递增的权重来平衡不同阶段和迭代之间的深度监督。动机是深度应该从粗到细估计,因此误差会逐渐受到更多惩罚。

实现

发现使用标准高斯噪声,即 N(0,I),如 DDPM [23],将引入太强的噪声,无法进行细化。因此,我们将阶段 m 的高斯噪声设置为 N(0,σI)来控制噪声尺度。具体来说,当在 DTU 上训练时,我们将第 2 阶段的细化设置为 σ= 0.5,在第 3 阶段的细化设置为 σ= 0.1。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 This is a 部落格 of outbreak_sen!